SOSLAB

MOU 체결

국내 LiDAR Tier-1 SOSLAB과 MOU 체결. 시뮬 환경 내 semantic + Force/Stress 통합 라벨링 협력 논의 — 다양한 공동 PoC · 연구 가능성 탐색.

산업용 연성체 자동화에 필요한 Force/Stress ground-truth 데이터는 아직 충분히 공급되지 않습니다.

Space AI는 그 calibrated 데이터 레이어를 생성하고 보정합니다.

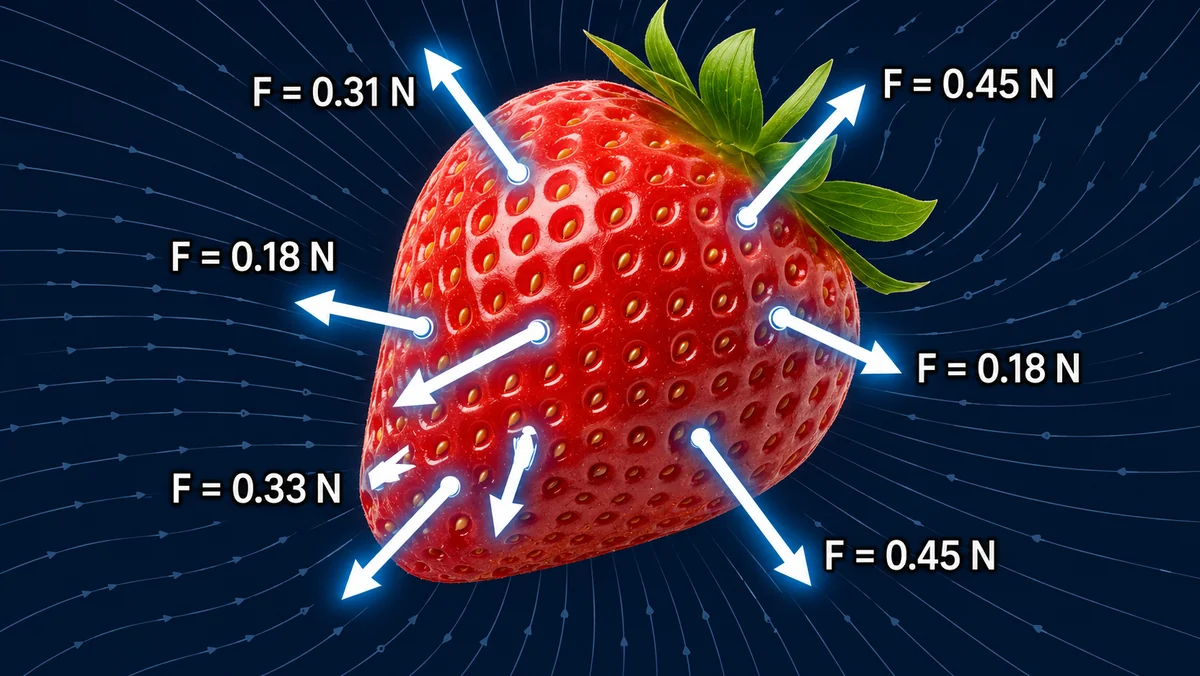

로봇이 딸기를 잡으려면 '얼마나 세게 쥐어야 부서지지 않는지' 알아야 합니다. 산업 현장에서 바로 학습에 쓸 수 있는 calibrated Force/Stress ground-truth 데이터는 아직 충분히 공급되지 않습니다.

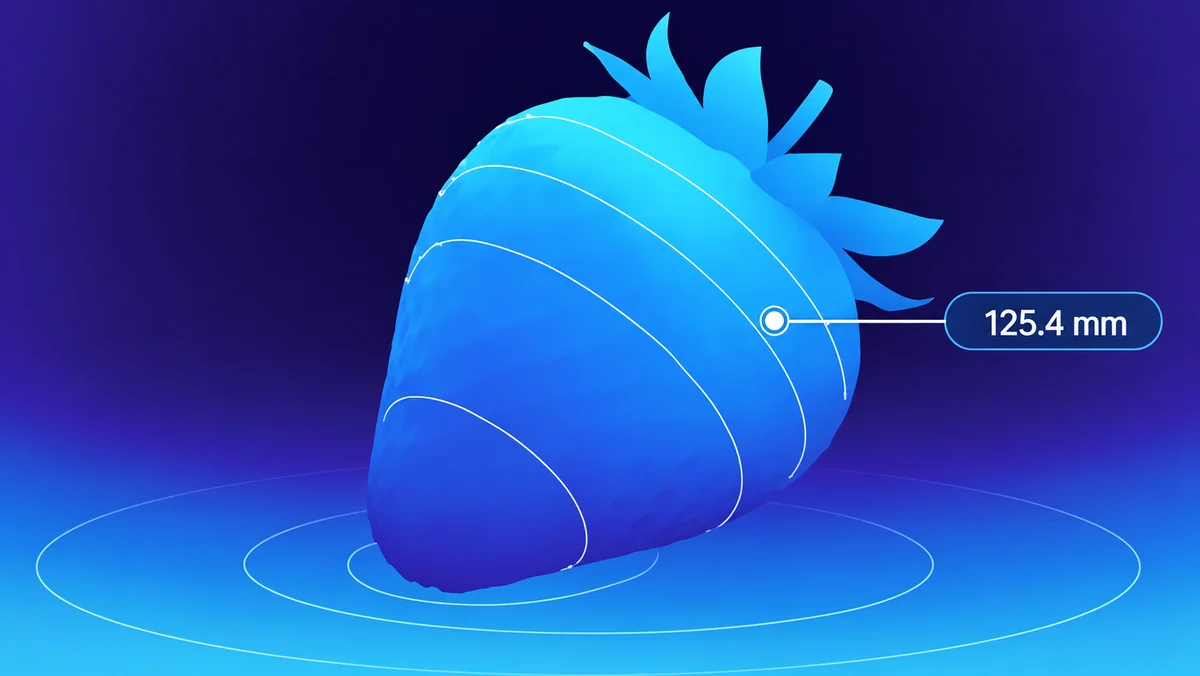

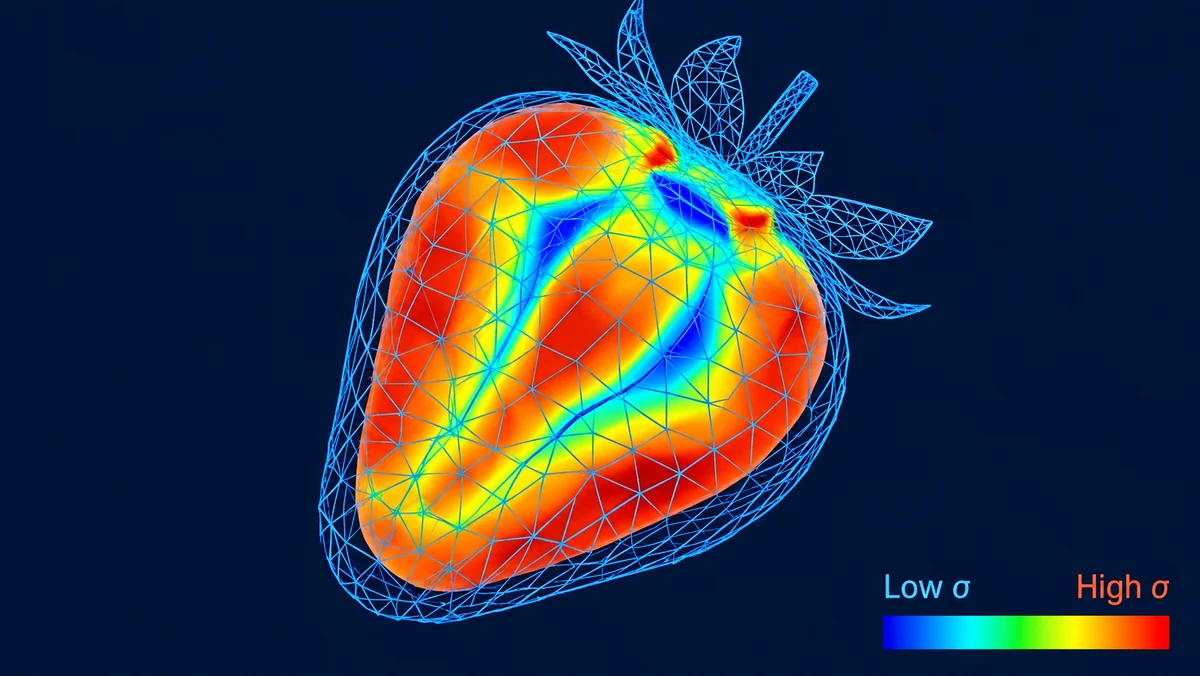

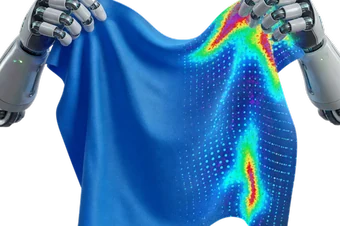

FEM/MPM/PBD 기반 deformable-contact simulation으로 물체의 변형·접촉력·응력장을 계산해 RGB · Depth · Force · Stress 4중 레이어를 같은 좌표계에서 정렬된 ground-truth로 출력합니다. L3(Force)·L4(Stress)는 대부분의 합성 데이터셋이 제공하지 않는 레이어입니다.

PoC 검토 전에 가장 자주 받는 질문 — "진짜 작동하나요?" 답은 자체 시연 영상이 아니라, 내부 controlled validation과 외부 PoC · Tier-1 협업 검증으로 확인 중인 정량 데이터입니다. 모든 수치는 재현 가능한 controlled experiment 기반.

내부 controlled validation · Franka 로봇 · 정밀 객체 파지

내부 controlled validation 기준 · 외부 공개 benchmark 아님 · 고객사 PoC에서 동일 프로토콜로 재측정

2024 ~ 2026 누적 · 선정 / LOI / PoC 논의 / 내부 검증 단계별 분류

Force / Stress Ground-Truth는 오늘 공장 자동화의 마지막 10%를 풀고, 내일 휴머노이드 시대의 표준 데이터 레이어가 됩니다.

자동차 호스, 광섬유 정렬, 식품 가공 — 연성체가 막아온 자동화의 끝자락. 이 한 시장만으로도 검증 · 계약 · 매출이 시작됩니다.

휴머노이드가 사람의 형태로 만들어진 이유는 사람의 모든 일을 대체하기 위함입니다. 그 시대의 한계는 하드웨어가 아니라, 로봇에게 물리를 가르치는 데이터입니다.

Scale AI는 자율주행 데이터를 구축해 멀티-빌리언 달러 기업으로 성장했습니다.

휴머노이드·로봇 파운데이션 모델 기업들은 이미 멀티-빌리언 달러 밸류에이션을 받고 있습니다. 그러나 대부분은 모델과 하드웨어에 집중합니다.

Space AI는 그 모델들이 접촉 물리를 학습하기 위해 필요한 Force/Stress 데이터 레이어에 집중합니다.

3년 만에 정부 · 산업 · 글로벌 3-Track 병행. 누적 외부 자금 ₩24억+, NVIDIA Inception · AWS Activate 크레딧 · H*** WIA 협업 논의, 그리고 TAI1 Summit @ InnoVEX 2026 발표 예정.

창업자는 누적 ₩24억+의 정부·민간 자금을 확보했고, NVIDIA Inception · H*** WIA PoC · AWS Activate 인프라 관련 협업을 추진했습니다. 올해 확보된 정부 R&D ₩10억은 비희석 자금으로 팀 확장을 지원합니다. Pre-A ₩75억은 합성 데이터 인프라 확장에 투입 — 공장 자동화 DaaS(Stage 1) → 글로벌 SaaS(Stage 2) 전환입니다.

국내 LiDAR Tier-1 SOSLAB과 MOU 체결. 시뮬 환경 내 semantic + Force/Stress 통합 라벨링 협력 논의 — 다양한 공동 PoC · 연구 가능성 탐색.

전국 2위 선정 (4파이널). PhysGraspGen 오픈소스 코어 + 100만 프레임 데이터셋 공개. ₩2.5억 사업화 지원.

CES 2026 현장에서 Aaron Parness (Amazon Robotics) 컨택 → AWS Korea 후속 미팅 → AWS Activate $10K 크레딧 지원 확보. Tactile data infrastructure 협업 탐색.

국내 최대 자동차 부품사 중 한 곳과 Force 데이터 협업 논의 중. FEM 기반 변형체 거동 시뮬레이션 + 적용 공정 후보 탐색 단계.

피지컬 AI는 5개 단계로 작동합니다. 반도체·하드웨어·시뮬 환경은 이미 성숙했고, 4단계 '부드러운 물체용 힘·응력 합성 데이터'가 차세대 데이터 레이어 영역입니다. Space AI가 그 자리에 들어갑니다.

자율주행과 휴머노이드 로봇이 발전해도, 로봇은 여전히 두부·천·광섬유 같은 부드러운 물질을 안정적으로 다루지 못합니다. 학습에 쓸 접촉력(Force)과 응력(Stress) 정답 데이터가 세상에 거의 없기 때문입니다.

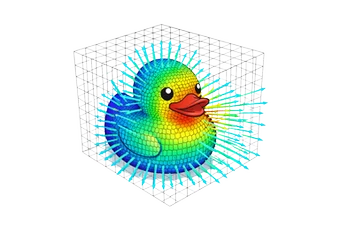

게임 엔진(Unity·Unreal)의 물리는 겉눈에 보이는 물리입니다 — 산업용 로봇 학습에는 쓸 수 없습니다. Space AI는 학계가 30년 누적한 FEM·MPM·PBD를 자체 코드로 결합해 한 엔진에서 함께 구동시킵니다.

물체 내부의 힘 계산 + 압력·응력 분포 시각화. 공장에서 부품을 잡고 누르고 변형시킬 때 실제와 같은 응력을 만들어 냅니다.

입자와 격자를 결합한 계산 방식. 두부·반죽·식품 가공처럼 기존 엔진이 풀 수 없던 영역의 변형·응력 데이터를 만듭니다.

직물·섬유 전용 실시간 주름·장력·변형 계산. 의류·와이어 하네스·광섬유처럼 유연한 물체를 빠른 속도로 합성합니다.

Synthesis AI·Datagen 같은 기존 합성 데이터 회사들은 "이미지를 만들고 라벨을 붙이는" 방식입니다. 눈에 보이지 않는 힘과 응력 같은 정보는 누락됩니다. Space AI는 물리 상태를 먼저 계산하고 그 결과로 이미지가 도출되는 반대 방향의 파이프라인을 구축합니다.

"처음부터 로봇을 직접 제어한다"는 부담을 제거. Off-line → Shadow → Assisted → Limited Automation 단계로 고객사가 통제권을 유지하며 검증합니다.

"기술이 흥미롭다"가 아닌 "당신 회사의 어느 KPI가 바뀌는가"의 답입니다. 투자 유치 미팅이 아닌, 회사의 매출·원가·품질·수주 경쟁력으로 직결되는 협업 검토 — 12주 PoC(Off-line 4주 + Shadow 8주)로 정량 검증 가능합니다.

투자 유치 마케팅이 아닙니다. PCT 출원 · LOI 체결 · 정부 선정 · NVIDIA 큐레이션 등 공시 가능한 사실로만 구성됐습니다.

NVIDIA Isaac Sim과 보완 관계인 연성체 Force / Tactile 데이터 레이어. NVIDIA Inception 생태계의 Physical AI 데이터 인프라 파트너로 검증.

4-Layer Ground Truth 데이터 + FEM/MPM 자체 엔진 + Sim-to-Real 84.2% (내부 검증). N-UP 프로그램 최종 선정.

NVIDIA Inception × StarFab 공동 주최 TAI1 AI Accelerator Summit 무대 발표 선정 — APAC 전체에서 단 4팀.

변형체 부품(고무 씰 · 케이블 · FPC) 핸들링 알고리즘 검증 필요. 사내 R&D만으로는 전문 데이터셋·시뮬 도구 부족.

FEM 기반 변형체 거동 시뮬레이션 + 알고리즘 협업 가능성 논의. 적용 공정 후보 탐색 단계.

Force / Stress GT 데이터 적용 범위에 대한 초기 협업 논의 단계. 별도 확정 사항 없음.

글로벌 풀필먼트 자동화의 마지막 1마일 — 박스 · 봉지 · 소프트 패키지 등 변형 페이로드 핸들링. 강체 가정 시뮬로는 한계.

물류 환경 변형 페이로드 FEM/MPM 시뮬 데모. CES 2026에서 Aaron Parness (Amazon Robotics, Senior Principal Scientist · Manipulation) 컨택 → AWS Korea 후속 미팅.

AWS Activate $10K 크레딧 지원 확보 (2026.01). Aaron Parness 컨택 → AWS Korea 미팅 경유. 글로벌 인프라 네트워크 접점.

시뮬레이션 환경의 semantic labeling이 시각 라벨에 머무름 — 물체별 force/stress ground truth가 빠짐. LiDAR 인지와 접촉 데이터를 결합한 완전한 학습 데이터셋이 필요.

국내 LiDAR Tier-1 SOSLAB과 시뮬 환경 내 semantic + Force/Stress 통합 라벨링 협력 합의. 임의 물체에 대한 LiDAR × Force 통합 ground truth 라벨링 탐색 단계.

MOU 체결 (2026.05). 다양한 분야 협력 가능성 논의 — 후속 공동 PoC · 연구 검토 단계.

Space AI는 NVIDIA·Siemens·Ansys를 대체하지 않습니다. 그 위에 접촉/변형체 데이터 레이어를 추가합니다. NVIDIA Isaac Sim이 제공하는 강력한 시뮬레이션 기반 위에, 고무 호스나 와이어 같은 연성체의 Force/Stress 데이터 레이어를 더합니다.

"자동 전환" 없음. 각 단계마다 고객사 내부 평가위원회 / 구매 / 법무 절차 존중.

투자 유치가 아닙니다. 회사 내부에서 즉시 검토 가능한 PoC 패키지가 산출물입니다. 미팅부터 검증 리포트까지 명확한 타임라인 + KPI 미달 시 회사 리스크 0의 Exit Plan.

투자 유치가 아닌, "고객사 내부에서 바로 검토할 수 있는 PoC 패키지"가 산출물입니다. 1차 미팅에서 우선 검증 공정 1건 선정 → PoC 제안서 송부 → 12주 PoC 착수.

Pre-A ₩75억 진행 중 · 12주 PoC 매출 기반 · 외부 검증 신호 · 잠재 KOSDAQ IPO 또는 전략적 Exit 경로.

1차 미팅 후 데이터룸 접근 가능합니다.

2025–2026년, 4가지 신호가 동시에 떴다. 이 창은 길어야 18개월이다.

대기업 자동화 라인의 실제 TCO 비교. 첫 분기에 ROI 회수.

고객사별 구체적 단가와 PoC 스코프 — bottom-up 산정. 보수 시나리오 기준.

즉각적인 DaaS 매출로 시작해, 반복형 SaaS로 마진을 높이고, 글로벌 표준 API에 도달합니다.

보수 시나리오. 핵심은 규모가 아니라 속도 — 투자 후 약 18개월 내 Series A 트리거가 결판납니다.

우리가 푸는 시장은 공장 자동화의 마지막 30% — Goldman Sachs가 "수동 노동 20%" 라고 부른 영역. 그 위에 휴머노이드 시대가 열립니다. 단순 SW 판매가 아닌, Physical AI 인프라의 데이터 표준 공급자로 포지셔닝합니다.

Figure(₩52조) · Physical Intelligence(₩8.3조) · Skild AI(₩6조) — 모두 로봇의 뇌(Model)에 집중합니다. 학습용 촉감(Force) Ground Truth 공급자 자리는 글로벌에서 막 정립되는 카테고리입니다.

Isaac Sim이 시각을 만들면, Space AI는 그 위에 촉감을 더한다 — Physical AI는 두 레이어가 모두 필요하다. 단순 Exit 시나리오를 넘어, 로봇 물리 엔진의 글로벌 IP 라이선싱 기업으로 독립 성장도 가능한 구조입니다.

전체 재무 자료, 기술 검증 리포트, IP 포트폴리오, 고객 LOI 사본 — 모두 데이터룸에서 NDA 후 공개. 1차 미팅 후 접근 권한 부여.

아래 양식을 작성해 주시면, 김현규 대표가 1영업일 이내 직접 회신드립니다. Pre-A 라운드 자료(IR 덱·재무 모델)와 데모 영상을 함께 발송해 드립니다.

이메일 클라이언트가 열렸습니다. 전송 버튼을 눌러 주시면 김현규 대표에게 직접 도착합니다.

이메일이 열리지 않은 경우, 아래 주소로 직접 연락 주세요.

아래 양식을 작성해 주시면 김현규 대표가 1영업일 이내 직접 회신드립니다. 회사별 라인 환경에 맞는 PoC 후보 공정 1건 추천 + Sim-to-Real 검증 프로토콜을 함께 보내드립니다.

이메일 클라이언트가 열렸습니다. 전송 버튼을 눌러 주시면 김현규 대표에게 직접 도착합니다.

이메일이 열리지 않은 경우, 아래 주소로 직접 연락 주세요.

Figure AI가 다리를 움직이게 했다면, Space AI는 손이 만지는 것을 가르칩니다. NVIDIA · Universal Robots · Isaac Sim 생태계와 보완하는 Stage 4 — 로봇 시대의 마지막 데이터 레이어를 만듭니다. 이 카테고리의 글로벌 표준이 되는 것이 목표입니다.

비전이 같은 분, 가장 어려운 문제를 풀고 싶은 분을 모십니다. 김현규 대표가 1영업일 이내 직접 회신드립니다.

김현규 대표가 1영업일 이내 직접 회신드립니다.

전송이 되지 않은 경우, 아래로 직접 연락 주세요.